-

Atletica: Gout Gout contratto record, sei milioni a 16 anni

Atletica: Gout Gout contratto record, sei milioni a 16 anni

-

Alzheimer, scoperto il ruolo chiave delle guardiane del cervello

-

Unicef, 'mezzo miliardo di bambini vive in guerra'

Unicef, 'mezzo miliardo di bambini vive in guerra'

-

Mattarella, strage del rapido 904 atto eversivo, l'Italia reagì

-

Netanyahu all'esercito, 'distruggere le infrastrutture Houthi'

Netanyahu all'esercito, 'distruggere le infrastrutture Houthi'

-

Luigi Mangione in tribunale, si dichiara non colpevole

-

Sul Vespucci, tra i ricordi del libro dell'equipaggio

Sul Vespucci, tra i ricordi del libro dell'equipaggio

-

Netanyahu, 'progressi per l'accordo sugli ostaggi'

-

Zelensky, '3.000 i nordcoreani morti o feriti nel Kursk'

Zelensky, '3.000 i nordcoreani morti o feriti nel Kursk'

-

Fiorentina-Udinese: Bove atteso al Franchi, e sarà in panchina

-

Via libera dal consiglio dei ministri al decreto Caivano bis

Via libera dal consiglio dei ministri al decreto Caivano bis

-

Meloni, bene sostegni alla natalità, manteniamo gli impegni

-

Monza: Bocchetti è il nuovo allenatore

Monza: Bocchetti è il nuovo allenatore

-

Morta in ospedale: figlia, 'ho chiesto scusa a mia madre'

-

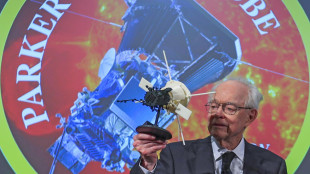

Tuffo da record nel Sole per sonda Parker alla vigilia di Natale

Tuffo da record nel Sole per sonda Parker alla vigilia di Natale

-

Il Cremlino smentisce che Asma Assad abbia chiesto il divorzio

-

Lucio Corsi, ad aprile tour nei club

Lucio Corsi, ad aprile tour nei club

-

Monza, esonerato Alessandro Nesta

-

Oim,674 morti e 1015 dispersi nel Mediterraneo centrale nel 2024

Oim,674 morti e 1015 dispersi nel Mediterraneo centrale nel 2024

-

Nano-antenne wireless per ascoltare le cellule

-

Harry Potter e il Principe Mezzosangue in concerto a Roma

Harry Potter e il Principe Mezzosangue in concerto a Roma

-

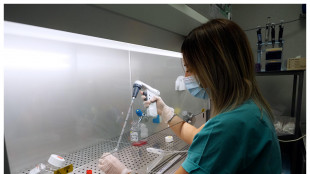

>ANSA-LA-STORIA/ Dall'Iraq al Meyer, un nuovo volto per Hussein

-

Affitti brevi: Aigab al Viminale, buon dialogo su self check in

Affitti brevi: Aigab al Viminale, buon dialogo su self check in

-

Cdm: norvegese Haugan vince slalom Badia, azzurri molto indietro

-

Cremlino, per ora non ci sono piani incontro Putin-Trump

Cremlino, per ora non ci sono piani incontro Putin-Trump

-

Hamas, a Gaza 58 uccisi da raid israeliani in 24 ore

-

Dazn prosegue la sua espansione, acquisita Foxtel in Australia

Dazn prosegue la sua espansione, acquisita Foxtel in Australia

-

Borsa: Europa senza direzione, future contrastati, Milano +0,2%

-

Giubileo: Gualtieri, pochi ci credevano, ce l'abbiamo fatta

Giubileo: Gualtieri, pochi ci credevano, ce l'abbiamo fatta

-

Come degustatori esperti, 2 algoritmi sanno annusare il whisky

-

Lega serie A: annullato il Consiglio del 27 dicembre

Lega serie A: annullato il Consiglio del 27 dicembre

-

Ritrovati 4 arredi originali del villino di Puccini di Viareggio

-

L'Ue raggiunge i 300 miliardi come esborsi del Pnrr

L'Ue raggiunge i 300 miliardi come esborsi del Pnrr

-

Orban, 'l'Ue ha perso la sua guerra, con Trump una nuova era'

-

Il gas balza sopra quota 45 euro sul mercato Ttf di Amsterdam

Il gas balza sopra quota 45 euro sul mercato Ttf di Amsterdam

-

Zelensky, 'il premier slovacco Fico vuole aiutare Putin'

-

Tutti in fila per il mausoleo dei Florio

Tutti in fila per il mausoleo dei Florio

-

Cade un albero a Roma, morta una donna

-

Borsa: Milano invariata, corre Leonardo, giù Buzzi e Stellantis

Borsa: Milano invariata, corre Leonardo, giù Buzzi e Stellantis

-

Oms, attuale vaccino Covid funziona anche su nuove varianti

-

La Ue eroga la sesta rata Pnrr da 8,7 miliardi all'Italia

La Ue eroga la sesta rata Pnrr da 8,7 miliardi all'Italia

-

Scoperta l'Emoglobina Monza, si degrada con la febbre

-

Torna Bollicine, il concerto di fine anno della Senzaspine

Torna Bollicine, il concerto di fine anno della Senzaspine

-

'll ragazzo dai pantaloni rosa' Film dell'anno a Capri

-

Al via l'esame della manovra in Senato, opposizioni protestano

Al via l'esame della manovra in Senato, opposizioni protestano

-

Malattia in Congo, si indaga su influenza e co-infezioni

-

Borsa: Europa poco mossa, future Usa in rialzo, Milano +0,07%

Borsa: Europa poco mossa, future Usa in rialzo, Milano +0,07%

-

Ferrero, fatturato Italia in crescita a 1,8 miliardi

-

Meloni all'inaugurazione di piazza Pia, piccolo miracolo civile

Meloni all'inaugurazione di piazza Pia, piccolo miracolo civile

-

L'app Elty supporta i medici con l'AI e cresce del 30% al mese

Il paradosso dei chatbot, più crescono più sbagliano

Dà risposte errate piuttosto che ammettere l'ignoranza

Più crescono e fanno esperienza, maggiore è il rischio che rispondano in modo errato piuttosto che ammettere di non saper rispondere: è uno dei grandi problemi dei grandi modelli linguistici che alimentano i chatbot, come ChatGpt e Llama. A dirlo è lo studio pubblicato sulla rivista Nature da José Hernández-Orallo, dell'Istituto di ricerca per l'Intelligenza Artificiale di Valencia in Spagna, che sottolinea inoltre come questi errori sfuggano facilmente agli umani. Una delle importanti caratteristiche dei grandi modelli linguistici, o Llm, è la capacità di evolvere nel tempo integrando al loro interno nuove informazioni derivanti dalle interazioni con gli utenti o con gli sviluppatori, così da diventare teoricamente sempre più affidabili. Ma analizzando questo percorso in tre degli Llm più polari, in particolare ChatGpt di OpenAi, Llama di Meta e il modello aperto Bloom, i ricercatori spagnoli hanno osservato un cambiamento del loro comportamento. Secondo gli autori della ricerca i tre modelli inizialmente erano più propensi di oggi nell'ammettere di non poter rispondere a domande su questioni su cui non si sentivano certi di dare risposte accurate. Una prudenza che è andata gradualmente svanendo: "i modelli 'ingranditi' e modellati tendono a dare una risposta apparentemente sensata, ma sbagliata, molto più spesso rispetto al passato", affermano i ricercatori nell'articolo. I chatbot "stanno diventando più bravi a fingere di essere informati", ha commentato Hernández-Orallo. Un problema che si aggiunge inoltre all'incapacità da parte degli umani di riuscire a notare questi errori, spesso perché ci si fida automaticamente della macchina. Un problema che potrebbe essere parzialmente risolto impostando negli Llm una sorta di soglia di affidabilità più alta, al di sotto della quale l'IA non rilascia una risposta. Scelta possibile per i chatbot ideati per lavorare in settori specifici, ad esempio in campo medico, ma più difficile immaginare, sottolineano i ricercatori, possa essere introdotta da quelle aziende che sviluppano chatbot 'generalisti' che puntano proprio sulla capacità di risposta in settori molto ampi.

R.Adler--BTB